财联社2月25日讯(编辑 牛占林)以高度重视安全著称的人工智能公司Anthropic,正对其安全承诺作出重大调整。该公司当地时间周二表示,为在与其他AI实验室的竞争中保持优势,已对核心安全政策进行“软化”。

此前,若其模型被判定为“具有危险性”,Anthropic将暂停相关开发工作,多年来该公司高层反复强调这一承诺。但Anthropic如今表示,一旦竞争对手发布了“同类或更先进”的模型,将不再执行这一暂停机制。

这一变化,与两年半前形成鲜明对比。当时,Anthropic发布了一套用于指导新模型开发与测试的安全护栏框架,使其在AI行业中树立起“最重视安全”的公司形象。

Anthropic首席科学官Jared Kaplan最新表示:“我们认为,如果我们停止训练AI模型,实际上并不会对任何人有帮助。在AI快速发展的背景下,如果竞争对手正全速推进,我们单方面作出这种承诺并不合理。”

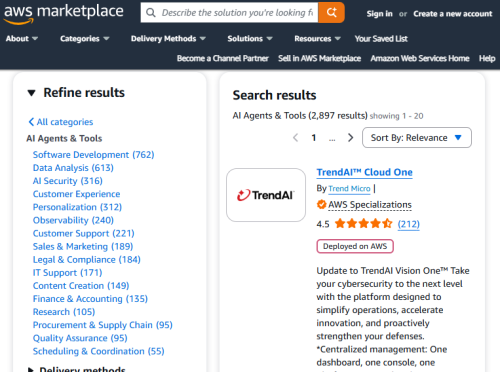

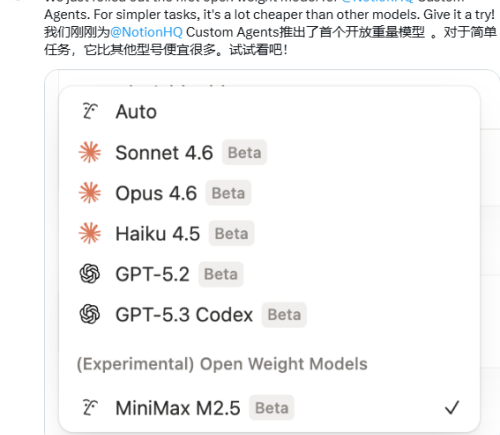

目前,Anthropic正面临来自多方的激烈竞争,包括OpenAI、xAI以及谷歌等公司,这些竞争对手频繁推出前沿工具。同时,公司还与美国国防部陷入拉锯战。

据财联社稍早报道,美国国防部长皮特·赫格塞斯给Anthropic首席执行官Dario Amodei下了“最后通牒”,要求他在本周五之前取消其AI模型上的安全措施,否则将面临失去五角大楼合同的风险。

Anthropic表示,此次政策调整是基于AI技术发展速度加快,以及联邦层面尚未建立完善监管框架所作出的更新。该公司最初作为AI安全研究实验室成立,此前曾就模型透明度与安全护栏问题倡导州及联邦立法,并与特朗普政府在相关监管议题上产生分歧。特朗普政府则试图限制各州对AI进行监管的能力。

Anthropic发言人称,此次调整旨在帮助公司在政策环境不均衡的背景下,与多家竞争对手展开竞争。当前环境下,企业需自行判断安全防护标准。她强调,安全承诺的修改与五角大楼谈判“无关”。

Anthropic在博客中表示:“政策环境已转向优先强调AI竞争力与经济增长,而以安全为导向的讨论在联邦层面尚未取得实质性进展。”公司同时强调,仍将坚持行业领先的安全标准。

近几周,多名AI研究人员陆续离开Anthropic及其他AI公司,并警告称,随着企业融资规模不断扩大并考虑IPO上市,安全及其他审慎因素正被边缘化。OpenAI与谷歌同样面临类似挑战。

Anthropic成立于2021年,由Amodei及其他联合创始人自OpenAI离职后创立。他们当时担忧ChatGPT开发方在安全问题上的重视程度不足。

2022年,Amodei曾拒绝发布Claude的早期版本,担心这将引发危险的技术竞赛。数周后,OpenAI推出ChatGPT,迫使Anthropic进入追赶状态。

对于是否向市场压力让步的质疑,Kaplan回应称,公司反而是在重申对安全的承诺:“如果所有竞争对手在灾难性风险问题上都透明且负责任,我们承诺做到同等或更好。但在他人继续推进、而我们并未为生态系统增加额外风险的情况下,停止参与AI研究与安全工作,甚至因此失去对前沿技术的理解与创新相关性,是没有意义的。”