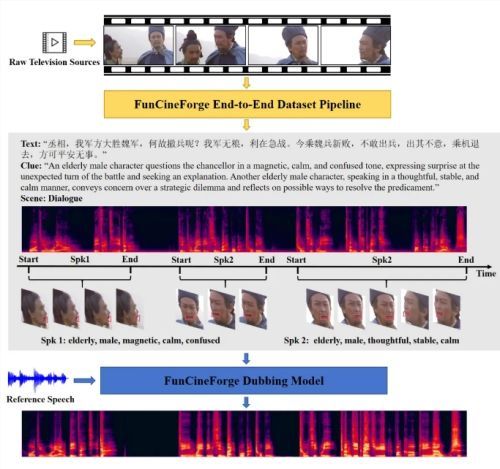

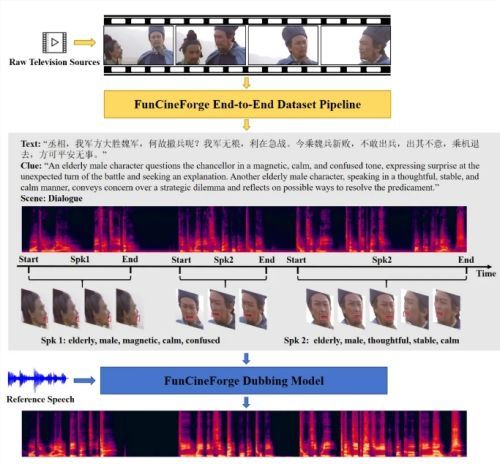

传统的 AI 配音在面对影视、动画等高标准场景时,常因难以匹配复杂的情绪爆发和精准口型而遭遇瓶颈。针对这一痛点,通义实验室正式发布并开源了首个影视级多场景配音多模态大模型——Fun-CineForge。

突破“声画脱节”:四大严苛维度的协同

不同于仅依赖文字转语音的传统模型,Fun-CineForge 旨在攻克影视制作中的四大核心挑战:

-

口型同步: 实现合成语音与画面唇部运动的高度一致。

-

情绪表达: 结合面部形象与指令描述,赋予声音拟人化的情感深度。

-

音色一致性: 在复杂的多角色对话中保持特定人物的音色稳定。

-

时间对齐: 即使说话人被遮挡或不在画内,语音也能在毫秒级精确的时间点切入。

核心技术:引入“时间模态”与高质量数据集

Fun-CineForge 的技术突破在于其独有的 “数据+模型”一体化设计:

-

CineDub 高质量数据集: 通义实验室配套开源了 CineDub 自动化数据集构建流程。该流程利用思维链纠错机制,将中英文文本转录错率降至 1% -2% 左右,说话人分离错误率大幅降至 1.2%。

-

四模态融合架构: 模型首次引入 “时间模态”,配合视觉(唇形表情)、文本(台词情感)和音频(音色参考)共同建模。这使得模型即便在“看不到”人脸的复杂场景下,也能依靠时间监督目标实现精准同步。

表现卓越:填补多人对话配音空白

实验数据显示,Fun-CineForge 在词错率(WER/CER)、唇部同步度(LSE-C/D)及音色相似度上均显著优于 DeepDubber-V1等基线模型。尤其值得关注的是,该模型首次实现了对双人及多人对话场景的精准支持,在30秒以内的视频片段中表现出极强的鲁棒性。

-

GitHub:https://github.com/FunAudioLLM/FunCineForge

-

HuggingFace:https://huggingface.co/FunAudioLLM/Fun-CineForge

-

ModelScope:https://www.modelscope.cn/models/FunAudioLLM/Fun-CineForge/