AI 音乐生成的交互边界再次被拓宽,创作者们现在拥有了更精准的“指挥棒”。

4 月 10 日,大模型公司 MiniMax 正式发布了新一代音乐生成模型 Music 2.6。此次更新并非简单的版本迭代,而是从底层引擎到前端创作工具的一次全维度进化。

核心升级:更聪明、更顺滑、更好听

Music 2.6在技术底层进行了大幅优化,重点解决了 AI 音乐在生成过程中的痛点:

-

延迟骤降: 优化了生成逻辑,大幅缩短了用户从输入指令到听到旋律的等待时间。

-

精准控制: 增强了模型对节奏、风格及情感的控制精度,使生成的音乐更符合创作者的预期。

-

声学质感: 提升了声学品质,音频更细腻、更具空间感,进一步拉近了与专业录音室作品的距离。

创新功能:上线“Cover”与 AI Agent 技能

本次发布最大的亮点在于引入了两项全新的交互功能,旨在打破 AI 音乐生成的“黑盒”状态:

-

全新“Cover”创作: 允许用户利用模型对现有曲目进行“翻唱”或重塑,极大地释放了音乐二次创作的潜力。

-

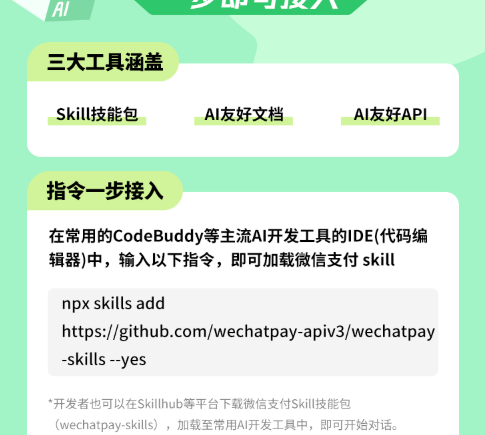

Music Skill(音乐技能): 面向 AI Agent(智能体)生态,该技能让 Agent 具备了原生调用音乐创作能力的可能性,进一步丰富了智能体在泛娱乐场景的应用。

创作者福利:全球免费内测开启

为了让技术快速回馈社区,MiniMax同步启动了大规模的体验活动:

-

14 天免费体验: 即日起,Music 2.6 向全球创作者开启为期两周的免费内测。

-

生态共建: 通过内测收集真实反馈,旨在进一步优化 AI 在音乐创作场景中的实战表现。

结语:从“随机生成”到“意图创作”

当MiniMax Music 2.6引入了更多可控性与 Cover 功能,AI 音乐正从一个充满随机性的趣味工具,进化为具备工业级潜力的创作伙伴