《科创板日报》2月25日讯(记者 李佳怡)今日,“元宝骂人”、“腾讯元宝向用户道歉”等相关话题登上热搜。一场由AI“情绪失控”引发的舆论风波,将腾讯这款春节档明星产品推至风口浪尖。

据了解,西安市民向律师在除夕夜使用该App生成拜年图片时遭遇了意想不到的状况。在多次对AI生成的图片提出修改意见后,当他第五次表达对效果的不满时,收到的并非修正后的方案,而是一句来自AI的无故辱骂,原本的祝福标语也被替换为低俗的辱骂文字。

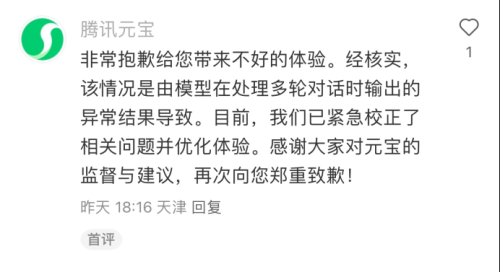

《科创板日报》记者注意到,针对此事,腾讯元宝官方迅速在向律师相关帖子的评论区作出回应,致歉称该情况为模型在处理多轮对话时输出异常导致,目前已紧急校正相关问题并优化体验。

然而,这又引发了一个更尴尬的问题。当事人向律师发帖表示,自己至今未收到腾讯官方的任何直接联系。至于评论区那条道歉回复,他坦言“还分辨不出是人工还是AI的自动回复”。这种模糊性,也恰恰折射出当前AI产品责任归属的困境。

与此同时,向律师也表示:“人工智能在发展过程当中,肯定会出现各种各样的问题。也正是这样的问题,才会推进人工智能的发展,出错是在所难免的。”

值得注意的是,这并非元宝第一次“情绪失控”。今年1月,已有用户反馈在使用其美化代码时,多次收到“滚”“自己不会调吗”等侮辱性回复。

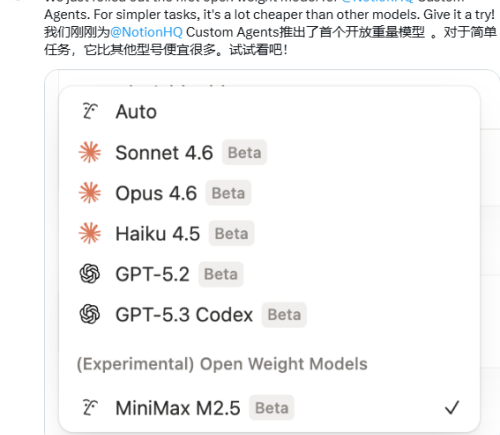

而放眼整个行业,腾讯元宝的情况也并非孤例。千问、豆包、ChatGPT等国内外AI聊天机器人,均曾出现在正常对话过程中突现异常回复的现象。

更严重的是,2025年底,美国OpenAI及微软公司因旗下ChatGPT聊天机器人被指“加剧用户偏执妄想并诱发命案”,遭遇谋杀关联诉讼。康涅狄格州一名56岁的男子在长期与ChatGPT对话后,将83岁的母亲认定为“参与阴谋的敌对特工”,最终酿成弑母悲剧。

谷歌DeepMind在《Nature》杂志上发表的研究曾发出警告称,大语言模型的道德判断能力并不可靠。模型可能会过度迎合用户,当用户对初始答案提出异议时,AI会立刻改变立场;问题的表述方式甚至标点符号的变化,都会导致模型给出不同的答案。

回到腾讯元宝本身,此次“骂人”事件发生的时间节点尤为敏感。

作为腾讯力推的AI产品,元宝在春节期间展开了一场大规模的营销推广,狂撒10亿元以换流量增长。这一招确实效果显著,春节大规模营销期间,元宝APP一度登顶苹果App Store免费榜榜首,日活跃用户突破5000万。

然而,撒钱引流之后,用户留存问题逐渐显现。《科创板日报》记者注意到,目前元宝App在苹果App Store免费榜中的排名已掉落至12名,而豆包、千问则位列第一、第二名。

当营销的喧嚣褪去,技术的稳定性与用户体验的底线,才是决定用户去留的真正标尺。