作者:李鑫 出品:具身智能大讲堂

机器人接到自然语言指令后,如何精准转化为流畅的物理动作,一直是通用机器人研发的核心卡点。

近日智元机器人联合北航研究团队提出的全新ACoT-VLA框架 ,正式入选计算机视觉顶会 CVPR 2026。

该框架跳出了传统视觉-语言空间的间接推理模式,让机器人直接在动作空间完成思考与决策,在LIBERO、LIBEROPlus、VLABench三大权威基准测试中创下98.5%、84.1%、47.4%的成功率新高,同时在真实机器人平台的多任务测试中表现亮眼 。

目前,ACoT-VLA 已作为 AGIBOT WORLD CHALLENGE的官方基线模型正式开源,助力全球开发者攻克复杂机器人操控难题。

AGIBOT WORLD CHALLENGE是由智元发起的全球性具身智能挑战赛,旨在攻克真实场景下的机器人通用操控难题。参赛者可基于 ACoT-VLA 开源代码,在智元提供的AgiBot World Colosseo仿真平台Genie Sim 3.0上进行二次开发与创新。

PART 01

通用机器人的核心卡点:语义与动作的天然鸿沟

Vision-Language-Action(VLA)模型是当前通用机器人的核心 策略 基础,这类模型依托预训练的视觉-语言模型(VLM),将视觉观测和语言指令编码为隐式特征,再由动作解码器转化为机器人的执行动作。但在实际应用中,这类模型始终绕不开一个关键问题——语义-运动鸿沟。

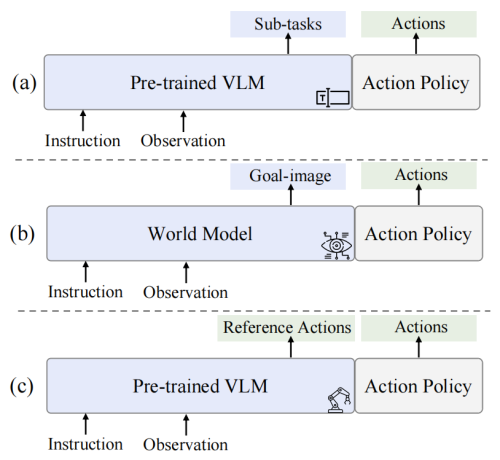

VLM的预训练数据多来源于互联网海量文本和图像,核心优化目标是语义对齐和语言理解,而非物理世界的运动规律和动力学特征,其编码的知识本身就与机器人的动作执行需求脱节。即便后续出现的世界模型类方法,通过预测未来视觉状态为动作生成提供指导,本质上仍停留在视觉表征层面,并未触达动作执行的核心。

不管是通过语言生成子任务的间接推理,还是通过合成目标图像的视觉引导,现有方法都只是在输入空间做文章,无法传递精准动作执行所需的细粒度、高维度运动信息。

就像用文字描述舞蹈动作,再精准的语义表达,也难以复刻出肌肉控制和肢体协调的细节,这种间接指导模式,直接导致机器人在复杂操作、长周期任务中容易出现误差积累,面对环境扰动时的鲁棒性也大打折扣。

PART 02

ACoT-VLA框架提出把思考过程搬到动作空间里

针对语义-运动鸿沟的核心问题, 智元北航联合研究团队提出了Action Chain-of-Thought(ACoT)全新推理范式,彻底改变了通用机器人的思考逻辑,不再让机器人在语言或视觉空间做抽象推理,而是直接将推理过程构建在动作空间中,把思考转化为一系列结构化的粗粒度动作意图,让每一步推理都直接指向动作执行,从根源上解决间接指导的信息损耗问题。

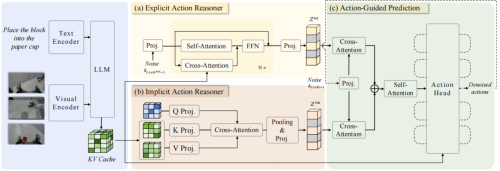

为此团队设计了ACoT-VLA一体化框架,核心搭建了两个高度互补的推理模块,分别从显式和隐式两个维度为动作生成提供精准指导。

其中显式动作推理器(EAR)以轻量级Transformer为基础,能基于多模态观测信息,自主合成粗粒度的动作参考轨迹,相当于为机器人规划出一条明确的动作路线,提供直接可执行的动作空间指导;隐式动作推理器(IAR)则聚焦于VLM内部的多模态表征,通过可学习查询与下采样后的特征做跨注意力建模,从语言指令的语义和视觉场景的细节中,提取潜在的动作先验分布,捕捉那些没有被明确表述但隐含在环境中的动作倾向。

简单来说,EAR是机器人的"动作规划师",给出清晰的动作轨迹参考;IAR则是"环境感知员",挖掘指令和场景中隐藏的动作线索,两者协同形成的动作思考链,让下游的动作生成模块能同时获得显式轨迹指导和隐式行为先验,实现更精准、更稳健的动作预测。

在框架的训练设计上,团队还针对性解决了推理器训练不稳定的问题,采用教师强制稳定策略:训练阶段直接用真实的动作轨迹生成显式指导,避免EAR的预测误差干扰动作头的训练;推理阶段则切换为完全自条件模式,由EAR自主生成参考动作,确保模型在实际部署时能独立完成决策。整个框架通过流匹配均方误差损失函数优化,平衡显式动作推理和最终动作生成的训练目标,让两个核心模块能协同优化、高效配合。

PART 03

三大基准刷新纪录,各任务表现全面领先

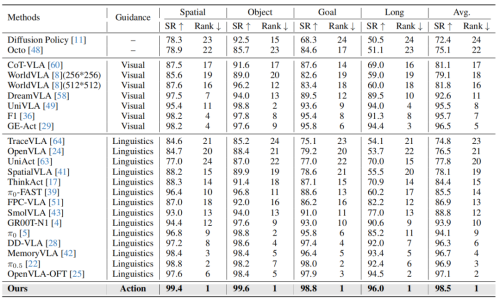

为了验证ACoT-VLA的实际性能,团队在三个主流仿真基准平台开展了全面测试,同时与当前主流的VLA模型、世界模型类方法做了对比,结果显示ACoT-VLA在所有测试维度均实现领先,多项指标刷新SOTA。

在LIBERO基准测试中,该框架拿下98.5%的平均成功率,在空间感知、物体中心操作、目标完成、长周期推理四个子套件中均排名第一,其中长周期任务套件的成功率达到96.0%,相比此前的最优方法有显著提升。

长周期任务对机器人的误差控制能力要求极高,而ACoT-VLA凭借动作空间的直接推理,避免了语言或视觉推理的误差积累,成为提升该类任务性能的关键。

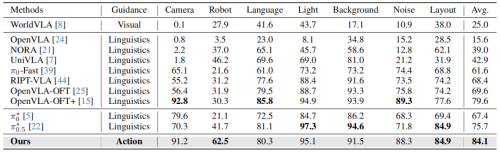

LIBEROPlus作为LIBERO的升级版,重点考察模型在环境扰动下的鲁棒性,设置了相机视角变化、机器人初始状态偏移、语言指令变体、光照变化、背景纹理改变、传感器噪声、物体布局变化七大扰动维度,总计10030个评估episode,测试条件更贴合真实应用场景

。ACoT-VLA在这一基准中实现84.1%的平均成功率,在相机视角偏移、机器人初始状态扰动、传感器噪声等传统方法的薄弱环节,分别实现11.6%、16.3%、12.5%的成功率提升,充分证明了动作空间指导在提升模型抗干扰能力上的核心价值。

在大规模的VLABench基准测试中,团队采用意图得分(IS)和进度得分(PS)双指标评估,ACoT-VLA在分布内、跨类别、常识推理、语义指令、未知纹理五大赛道的双指标均位列第一,其中未知纹理赛道的意图得分提升12.6%、进度得分提升7.2%,展现出极强的分布外泛化能力,即便是面对从未见过的物体外观,也能准确理解指令并完成动作执行。

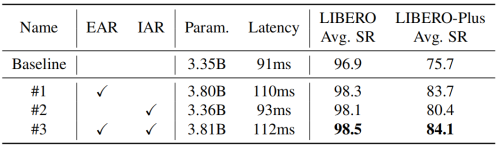

团队还开展了系统性的消融实验,验证各核心模块的有效性。以LIBERO基准为测试对象,单独加入EAR模块,能将平均成功率从96.9%提升至98.3%;单独加入IAR模块,平均成功率提升至98.1%;而当两个模块结合时,成功率进一步达到98.5%的最佳成绩,清晰证明了显式动作轨迹和隐式动作先验的互补价值。同时实验还发现,EAR模块的参数规模并非越大越好,300M参数的配置表现最优,过大的参数会导致模型过拟合训练数据中的虚假关联,反而生成有偏差的参考轨迹,影响最终动作执行。

PART 04

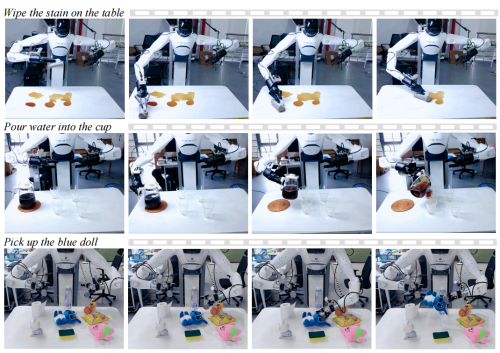

跨机器人平台适配,多任务成功率达66.7%

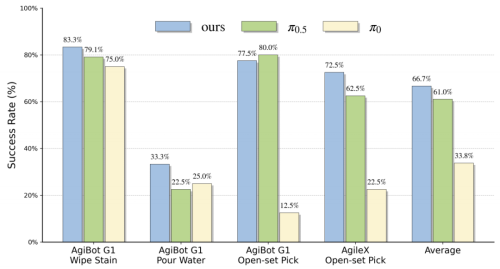

仿真测试的优异表现,最终需要落地到真实机器人平台才能体现价值。团队在智元精灵 G1和AgileX两款不同自由度、不同架构的机器人平台上,开展了真实世界的操作测试,选定擦拭污渍、倒水、开放集抓取三大典型任务,全面验证ACoT-VLA的实际部署能力。

这三大任务分别对应了机器人操作的不同核心能力:擦拭污渍需要精准的力控调节和工具-表面的接触控制,属于接触密集型操作;倒水涉及抓取、对准、控流、归位等多步骤连贯动作,对动作的精细度和连贯性要求极高;开放集抓取则要求机器人根据随机的自然语言指令,从多样的桌面布局中精准识别并抓取目标物体,考验模型的指令理解和视觉识别与动作的协同能力。

测试结果显示,ACoT-VLA在真实场景中的平均成功率达到66.7%,显著高于对比模型π₀.₅的61.0%和π₀的33.8%。更值得关注的是,该框架在22自由度的 智元精灵G1 和14自由度的AgileX平台上均表现稳定,开放集抓取任务在两款平台上的成功率均保持较高水平,证明其具备良好的跨体化适配能力,无需针对特定机器人平台进行大量的重新训练和调优,大幅降低了实际部署的成本。

在推理效率上,ACoT-VLA也实现了性能与开销的平衡。相比基础模型,加入EAR和IAR模块后,推理延迟仅从91ms小幅增加至112ms,这种轻微的计算开销增加,换来的是性能的大幅提升,为其在实际机器人平台的部署奠定了基础。

PART 05

3D空间推理与轻量化,解锁更复杂机器人操作

尽管ACoT-VLA在仿真和真实场景中均取得了突破性表现,但团队也明确了当前框架的局限性,以及后续的核心探索方向。目前框架的EAR和IAR模块虽未带来过大的计算开销,但对于算力资源受限的小型、便携式机器人平台,仍有进一步轻量化优化的空间,如何在保持性能的前提下压缩模型参数、降低推理延迟,是实现更广泛部署的关键。

此外,当前机器人的动作表示主要基于关节角度、末端执行器姿态等低级别控制指令,这类表征虽能精准描述动作本身,却缺乏明确的几何结构,难以支持更高级的空间推理,比如多物体协同操作、精密装配中的接触几何判断等,限制了ACoT范式潜力的充分释放。

团队将后续的研究重点放在两个方向:

一是探索富含空间接地信息的动作表示方法,让ACoT的推理过程能在几何可解释的3D空间中进行,让机器人能更好地理解物体间的空间关系,实现更复杂的空间操作;

二是持续推进模型的轻量化设计,通过模型压缩、量化、蒸馏等技术,让ACoT-VLA能适配更多算力受限的机器人平台,进一步降低落地门槛。从语言和视觉空间的间接推理,到动作空间的直接思考, 智元与北航联合提出 ACoT-VLA 框架 ,不仅刷新了通用机器人 策略 的性能指标,更重要的是为通用机器人的研发提供了全新的范式思路。

当机器人能直接用动作完成思考与决策,语义与动作之间的鸿沟被彻底填平,通用机器人在工业生产、家庭服务、商业服务等场景的落地应用,也将迎来更快速的发展。

论文链接:https://arxiv.org/abs/2601.11404

代码仓库:https://github.com/AgibotTech/ACoT-VLA