作者:李鑫 出品:具身智能大讲堂

大语言模型在静态视觉问答中表现亮眼,可到了真实物理世界,就连抓起一个苹果这样的简单动作,都可能接连失手。

AgenticLab的出现,填补了真实场景测试的空白。这个开源平台搭载UR5e机械臂与定制化低成本夹具,整套夹具成本不足200美元,通过Azure Kinect全局相机与RealSense D405腕部相机的双视角配合,实现了从全局场景感知到局部精细操作的无缝切换。

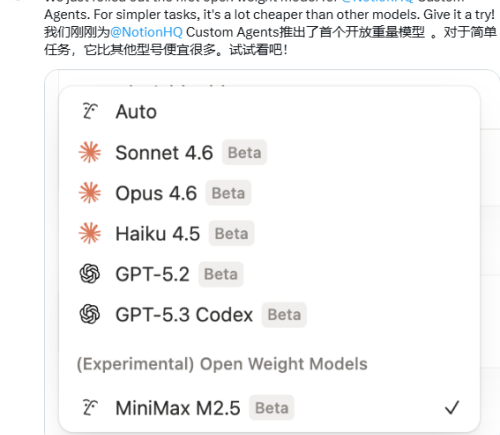

更关键的是,它搭建了一套模型无关的闭环推理框架,无论是Gemini、GPT还是Qwen系列模型,都能通过统一接口接入测试,实现公平对比,彻底改变了此前各研究团队因专属测试环境导致结果无法对比的现状。

研究团队做过一组测算:在分拣任务中放置三个物体,需要触发六次动作检查,即便模型单次验证准确率达90%,完成全程的概率也仅为53%;若准确率降至50%,成功概率会骤降至1.5%,误差的复利效应尽显。

Qwen3-VL-Plus和GPT-4o + LangSAM的表现同样不尽如人意,成功率分别为25%和5%,主要失败原因集中在物体检测偏差和放置位置误差。Gemini Robotics则以50%的成功率处于中游水平,其优势在于较低的token消耗,仅为40.6k,显现出专为机器人场景优化的特性。

PART 03

模块拆解测试,找准VLM操控机器人的能力瓶颈

为了精准定位模型在实体操控中的问题根源,研究团队将AgenticLab的闭环流程拆解为五大核心模块:任务解析器、物体检测器、动作检查器、抓取规划器和目标检查器,开展独立的基准测试,每个模块都在相同的感官设备和提示词设置下,跨多个场景和任务完成测试。

物体检测模块

测试结果打破了"模型越大性能越好"的固有认知:Qwen3-VL-Plus的指向准确率高达88.1%,Molmo-7B也达到76.2%,均优于Claude-4.5-Sonnet等更大规模的模型。但Qwen系列模型的边界框准确率方差较大,在杂乱场景中容易出现完全误识别的情况,暴露出其鲁棒性不足的短板。

动作检查模块

动作检查器被证实是整个操控系统的最大瓶颈。

尽管多数模型在孤立的VQA测试中准确率超过50%,但到了真实场景中,由于需要解读物体遮挡、抓取稳定性等复杂的交互语义,这些模型的验证能力大幅下降。

相比之下,Gemini 3 Flash的动作检查成功率达到100%,平均响应时间仅5.3秒,这也是其整体表现领先的核心原因。

抓取规划模块

表现更考验模型的综合推理能力。Gemini 3 Pro、GPT-5.2和Claude Opus分别以77.8%、75.9%和70.4%的成功率脱颖而出,原因在于它们能对碰撞风险、抓取稳定性、目标-物体匹配度等交互层面的语义进行深度推理,而本地模型往往难以做出有效判断,频繁输出无效结果。

PART 04

组合式流水线显优势,按需搭配突破单模型局限

基于模块测试的发现,研究团队搭建了一套组合式流水线:由Gemini Flash负责任务解析和抓取规划,Qwen3-VL-Plus专门处理视觉定位,Claude Opus承担任务完成度评估。这种"专人专岗"的组合模式,展现出灵活的性能优化潜力。

在堆叠任务中,Qwen3-VL-Plus的高精度定位能力有效提升了物体放置的精准度,解决了单模型容易出现的位置偏移问题;而在重定向任务中,仅将该环节替换为Gemini 3 Pro负责姿态推理,利用其更强的3D语义理解能力,就显著改善了物体姿态调整的成功率,整个流水线的其他部分无需改动。

不过,组合式流水线并未在所有场景中持续领先Gemini Flash单模型基准。在从实验室到户外环境的迁移测试中,两者的性能均出现下滑,尤其是需要精细放置和持续目标跟踪的任务,性能下降最为明显。

这也表明,无论采用何种架构,应对复杂环境变化仍是VLM实体操控的共同挑战。值得关注的是,这种组合模式无需进行高成本的端到端重训练,仅通过模块替换就能实现性能优化,为低成本提升机器人操控能力提供了极具实用性的路径。

PART 05

消融实验揭秘:验证频率与抓取评估的取舍之道

针对动作检查器和抓取规划器两大核心组件的消融实验,清晰揭示了机器人实体操控中鲁棒性与效率的平衡逻辑。在抓取规划模块的测试中,启用抓取评估功能后,杂乱场景中的任务成功率显著提升,但执行时间也相应增加——这是因为模型会主动拒绝碰撞风险高或定位不准的抓取姿态,转而通过腕部相机获取更精细的视觉信息重新规划。

动作检查器的测试结果,则为实际部署提供了明确的指导:在无干扰的分拣任务中,无动作检查、仅目标检查和完整动作检查三种配置的性能差距不大;但在存在物体移动等人为干扰的场景中,完整动作检查的优势立刻显现。尤其是在强依赖前序动作的堆叠任务中,关闭动作检查会导致成功率骤降为0,因为早期的抓取偏差会被后续动作不断放大,最终导致整个任务失败。

仅启用目标检查的配置,则会陷入"亡羊补牢"的困境:模型要到所有动作完成后才发现目标未达成,此时需要从复杂的中间状态重新规划,反而增加了不必要的动作和耗时。研究团队由此得出实际部署的准则:对于存在强依赖关系或频繁干扰的任务,密集型验证是确保成功的必要代价;而对于简单、低干扰的任务,稀疏验证可在不显著影响性能的前提下,有效提升执行效率。

PART 06

对决微调VLA,无训练优势凸显闭环推理价值

将AgenticLab与经过专项训练的视觉-语言-动作模型(VLA)π₀.₅进行对比,更能凸显其设计思路的优势。研究团队为π₀.₅提供了40个分拣任务和30个堆叠任务的演示样本,通过LoRA微调使其适配具体任务场景,整个训练过程耗时长达38小时。但实测结果显示,经过微调的VLA表现仍落后于AgenticLab。

两者的核心差距体现在语义理解的精准度上:当指令要求"抓取玩具"时,VLA可能误抓食品;在需要精确放置的场景中,VLA的定位误差也明显大于AgenticLab。追根溯源,VLAs虽然能掌握特定的运动原语,但缺乏任务分解、动态验证和故障恢复的闭环能力,面对未经过训练的场景变化时,适应性极差。

而AgenticLab通过解耦推理、定位与执行环节,在无需任务特定训练的情况下,实现了更强的泛化能力。这种设计也避免了VLA常见的"灾难性遗忘"问题,既能应对已知任务的变体,也能处理未见过的新场景,这也是其在真实无结构环境中表现更优的关键。

PART 07

结语与未来

尽管AgenticLab在实测中表现亮眼,但仍存在需要突破的瓶颈。目前其依赖人工编写的PDDL领域文件,新任务场景的适配需要专业人员介入调整,这在一定程度上限制了平台的规模化应用;平台现有的动作原语集合为人工预定义,难以覆盖各类精细操作需求,新增技能往往需要额外的工程开发;

而频繁的验证步骤虽然提升了操控的可靠性,却也带来了不容忽视的延迟开销。针对这些问题,研究团队提出了明确的改进方向:探索基于学习的领域建模,让模型能够自动生成和优化PDDL文件,降低新场景适配的门槛;

结合学习型原子技能扩展动作库,同时保持平台接口的一致性,提升操作的丰富度;将大型VLMs蒸馏为小型专用模型,在不损失验证精度的前提下,降低验证环节的延迟,优化鲁棒性与效率的平衡。

对于机器人研发从业者,这项研究也提供了宝贵的实践指南:在实体机器人操控中,闭环一致性比开放式推理的丰富度更为重要,设计完善的验证机制,能及时发现执行故障,避免系统陷入难以恢复的状态;Gemini家族在各模块的综合表现优异,是实体机器人操控的优选基础模型,而Qwen2.5-VL-7B等本地模型在视觉定位任务上性价比突出,适合作为组合式流水线的专项组件。

随着AgenticLab硬件和软件栈的全面开源,更多研究团队将获得标准化的VLM实体操控测试平台。这一措施有望终结VLM实体操控领域"各说各话"的混乱局面,推动研究焦点从模拟环境转向真实世界,加速通用机器人代理的落地进程。

论文地址:https://arxiv.org/pdf/2602.01662

项目地址:https://agentic1ab.github.io/