传统具身大模型虽然为机器人赋予了任务推理能力,却始终存在一个致命短板,这些模型只能让机器人进行机械试错,却无法真正学会反思与总结。面对简单的物品归置任务,机器人可能反复将大物件硬塞进小盒子,却始终无法从失败中吸取教训,每一次尝试都像是从头开始。

近日,斯坦福大学李飞飞、贾佳俊团队联合西北大学研究者,提出了全新的 Reflective Test-Time Planning 框架,一举打破这一困境。该框架让具身智能体具备了类人的反思能力:行动前可模拟预判,行动后能复盘优化,甚至通过追溯反思修正早期决策失误,让机器人在实际部署中真正实现 “从错误中学习”。相关成果已发布于 arXiv。

在团队全新设计的长时程家庭任务基准与 MuJoCo 橱柜适配基准测试中,该框架性能大幅超越现有基线模型,平均成功率提升超 20 个百分点;在真实机器人实验中,搭载该框架的机械臂能够有效避免重复放置错误,并根据后续结果修正早期不当决策,展现出极强的实际落地价值。

01.

三重反思机制:让机器人像人一样思考、复盘、修正

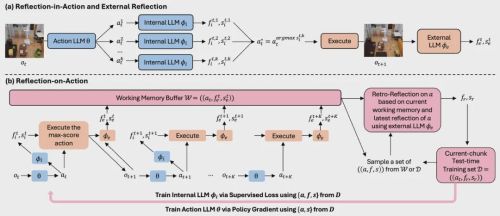

斯坦福团队提出的Reflective Test-Time Planning框架的整体逻辑是将行动中反思(reflection-in-action)和行动后反思(reflection-on-action)融合,并加入追溯反思(retrospective reflection)机制,构建起完整的闭环学习体系,让具身智能体在测试部署阶段实现持续的自我优化。

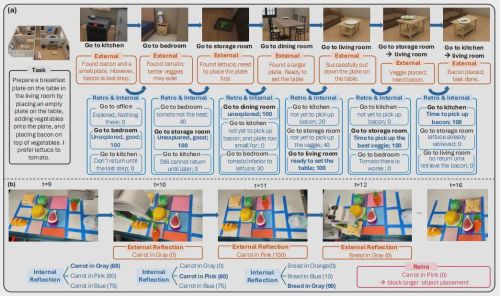

整个框架由三个相互协作的具身LLM支撑,均通过少量监督微调完成初始化,具备基础的环境推理、动作生成和反思能力:行动生成模型负责产生候选动作,内部反思模型完成行动前的评估打分,外部反思模型实现行动后的结果分析和追溯重评。三个模型在部署过程中动态交互,形成了一套完整的思考-执行-复盘-优化流程。

行动中反思:先模拟预判,再选最优行动

不同于传统模型贪心选择第一个看似可行的动作,该框架让机器人在执行前先完成内部模拟。通过高温采样生成多个候选动作,再由内部反思模型为每个候选动作生成自然语言评估,并给出0-100的数值评分,最终选择评分最高的动作执行。

比如在整理玩具任务中,模型会同时生成把玩具车放进绿色盒子放进橙色盒子先收集所有玩具再分类等多个候选动作,内部反思模型会结合物体尺寸、盒子容量等因素分析每个动作的合理性——比如判断绿色盒子尺寸不足,为该动作打0分,最终机器人会选择评分最高的合理方案。

这一过程通过测试时缩放实现,既避免了贪心决策的盲目性,又能提前过滤掉明显的错误动作,减少无效的物理世界试错。

行动后反思:以现实为依据,更新决策认知

行动中反思的预判始终基于模型的内部认知,难免与现实存在偏差——比如内部评估认为可行的动作,执行后却因未预见的物理约束失败。而行动后反思,正是让模型的认知落地现实的关键。

机器人执行完选定动作后,外部反思模型会结合执行结果、动作前后的环境观测,生成自然语言的外部反思,不仅给出成功/失败的判断,还会分析具体原因,比如放置失败,绿色盒子尺寸过小无法容纳玩具车,同时给出对应的评分。

这些即时的外部反思会被存入工作记忆缓冲区,当缓冲区达到指定容量,或遇到切换房间、重复失败等关键节点时,系统会启动测试训练,将反思转化为自监督训练信号,更新模型参数。

追溯反思:用后见之明,修正早期决策

即时外部反思只能评估单步动作的短期结果,无法解决长时序任务中的非局部失败问题。而追溯反思机制,让模型具备了 “后见之明”,能够结合后续任务进展,重新评估早期决策的合理性,完成长时程的信用分配。

触发追溯反思后,外部反思模型会根据当前环境状态与完整工作记忆,对历史动作进行重新评估,修正原有的评分与反思结论。例如,模型最初认为 “将小物件放入大隔间” 是成功操作,但后续发现这一行为导致大物件无处安放,追溯反思便会为该动作重新打上低分,并指出其阻碍后续任务的问题。

蓝色文字表示用于候选动作选择的内部反思,橙色文字表示执行后的外部反思,红色文字表示追溯反思。

这些经后验修正的反思结果,会成为更精准的训练信号,分别通过监督学习更新内部反思模型、通过策略梯度更新行动生成模型,前者让模型的前置预判更贴合现实,后者让模型更倾向于选择长期来看更优的动作,实现了阿吉里斯提出的双环学习:不仅优化具体的行动策略,更修正底层的推理逻辑。

02.

两大基准测试:全面验证,性能碾压现有基线

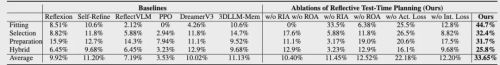

为充分验证 Reflective Test-Time Planning 框架的有效性,团队设计了两项针对性极强的基准测试,分别面向长时程多约束任务与几何放置约束任务。研究团队将该框架与语言反思、世界模型、强化学习等多个领域的主流基线模型进行对比,并通过消融实验验证了各反思组件的必要性。

长时程家庭任务:跨房间多步骤,考验失败恢复能力

该基准基于 BEHAVIOR-1K 环境构建,包含四类贴近真实场景的家庭任务,均需要跨房间执行、多步骤推理,并重点考验模型的失败恢复能力:

适配任务(物品装箱,考验几何与容量推理)

挑选任务(物品检索,考验偏好判断与探索策略)

准备任务(物品组装,考验顺序约束与依赖推理)

混合任务(融合多重约束,考验综合推理能力)

任务由 GPT-5 结合场景图自动生成,并提前嵌入多种典型失败模式,例如适配任务中的尺寸不匹配、挑选任务中过早决策导致错过最优解等,所有任务均在 BEHAVIOR 模拟器中完成物理验证,保证了任务的合理性与挑战性。

实验结果显示,Reflective Test-Time Planning 框架在所有任务类别上均大幅领先,平均成功率达到 33.65%,显著超越所有基线模型。其中难度最高的适配任务中,该框架成功率达到 44.7%,而最强基线模型 3DLLM‑Mem 仅为 10.6%,传统强化学习方法 PPO 更是直接为 0。

橱柜适配任务:受控环境,精准测试放置错误学习能力

为了排除复杂环境干扰、精准测试模型从几何放置错误中学习的能力,团队在 MuJoCo 中设计了一套橱柜适配基准。任务要求机器人将 6–10 个不同形状、颜色的几何物体,放入 6–8 个尺寸各异的橱柜隔间中,物体需与隔间边界完全贴合,且每个任务仅有一个最优解。

该测试以适配率(成功放入任意隔间的物体比例)和正确率(放入目标隔间的物体比例)为核心指标。最终,该框架实现了 60.2% 的适配率与 25.3% 的正确率,大幅优于各类基线模型。

03.

消融实验:各组件缺一不可,协同作用是关键

消融实验结果进一步印证了框架设计的合理性:行动中反思与行动后反思相互依赖、缺一不可,单独移除任意一个模块,都会造成性能大幅下降,甚至效果比同时移除两者更差。

例如,移除行动中反思后,准备任务成功率从 31.7% 骤降至 3.17%。原因在于缺少高质量候选动作,后续的行动后反思无法获得有效学习样本,只能在错误动作上反复优化。而移除行动后反思,则会让行动中反思的评分过度自信、与现实脱节,模型会持续选择看似最优、实则错误的动作。

同时,行动生成模型与内部反思模型的联合更新也至关重要。单独移除任意一个训练损失,都会导致模型性能下降。这表明,策略梯度更新与监督反思训练,为模型的自适应学习提供了互补且不可或缺的优化信号。

从模拟到现实:泛化能力优异,计算开销可控

该框架的价值不仅体现在模拟环境中,在真实机器人实验与跨环境泛化测试中同样展现出极强的实用性,且计算开销可控,为后续实际落地奠定了坚实基础。

在基于 Franka Panda 机械臂的真实橱柜放置实验中,搭载该框架的机器人能够从放置失败中快速调整策略,避免重复犯错;同时可通过追溯反思,识别早期放置行为对后续任务的影响并及时修正,最终顺利完成多物体的合理归置,验证了框架从仿真到现实的有效迁移能力。

在跨环境泛化测试中,团队将仅在 BEHAVIOR-1K 合成环境中训练的模型,直接部署至 Habitat-Matterport 3D 真实场景,框架仍取得了 19.5% 的成功率,而多数基线模型在此场景下成功率直接降至 0。这表明该框架学到的并非针对特定环境的固定策略,而是通用的反思与学习能力,能够有效应对环境分布偏移。

从计算开销来看,框架单步推理时间相比传统模型增加约 3 倍,主要消耗在候选动作生成、内部评估与测试训练环节。但这一开销具备极高性价比:行动中反思减少了无效物理试错,行动后反思避免了重复失误,最终以更高质量的执行轨迹抵消了计算成本。

团队还设计了一组对照实验:为传统模型提供 3 倍行动步数,使其推理耗时与该框架相当,但传统模型性能仍远低于框架,甚至出现下降。这说明单纯增加试错次数无法替代高效的反思学习,也印证了反思时间远比重复试错更有价值。

技术细节:这些设计,让反思落地更高效

Reflective Test-Time Planning 框架能取得优异表现,离不开一系列精心设计的技术细节,这些细节让反思机制更高效,也更贴合具身智能的实际部署需求。

在行动中反思环节,候选动作数量 N=6、采样温度 T=1.25–1.5 时性能达到最优。N 过小会导致可选空间不足,N 过大会加重计算负担,同时引入大量低质量候选动作;温度过低会让候选动作趋于同质化,温度过高则会生成无意义的无效动作,使内部评估失去实际意义。

测试时训练采用 LoRA 低秩适配技术,在仅更新少量参数的前提下,就能达到接近全参数微调的性能,其中 rank=8、alpha=16 为最优配置。参数配置过小会导致适配能力不足,难以捕捉精细的空间推理与反思逻辑;配置过大则容易出现模式崩溃,使模型丧失对不同场景的区分能力。

行动预算的设置同样关键,50 步为最优选择。30 步预算不足以支撑复杂任务的反思与调整,机器人常会因步数耗尽而无法完成任务;100 步的宽松预算则会让机器人陷入低效探索,反而积累更多错误。适度的约束,能够引导模型做出更聚焦、更具目标性的决策。

此外,框架采用单步动作生成,而非传统的滚动时域规划,有效避免了对未来的无效预测。具身任务中的物理交互具有较强不可预测性,提前生成的动作序列往往会因一步失败而整体失效,造成大量计算浪费。单步生成结合追溯反思,可让模型在持续学习中实现隐式长时程规划,在保证性能的同时,节省约 5 倍计算成本。

04.

结语与未来:

可以说斯坦福团队Reflective Test-Time Planning 框架重新定义了机器学习范式,从机械重复的试错,转向具备思考、复盘与修正能力的主动学习。

值得一提的是,目前,该框架的反思能力主要依托视觉观测与自然语言实现。未来,团队计划引入触觉、力觉等更多感官模态,在物体抓取、放置等任务中,借助更精细的物理交互信息,让机器人的反思更贴近真实物理世界。同时,研究还将进一步提升反思力度,从动作层面的反思,逐步深入到推理层面的反思,帮助机器人更精准地定位错误根源。、

论文地址:https://arxiv.org/pdf/2602.21198v1

项目地址:https://reflective-test-time-planning.github.io/