作者:Dabaoo 出品:具身智能大讲堂

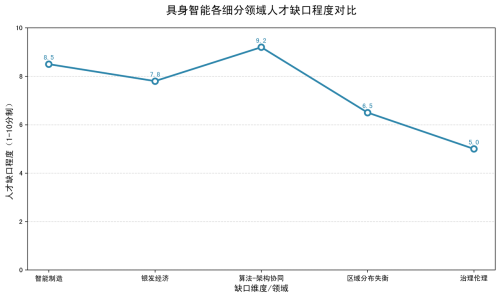

7类形态截然不同的机器人——无人机、无人船、轮足机器人、人形机器人、单臂和双臂机械手 , 在从未见过演示者的情况下,完成了30个多步协作任务,成功率达92%。这不是某次机器人竞赛的成绩单,而是近日发表于《Science Robotics》的一项真实研究成果。

这项研究由北京通用人工智能研究院 联合 深圳市人工智能与机器人研究院等单位合作 联合完成。 他们提出 了“意图对齐模仿学习”(Intention-Aligned Imitation Learning, IAIL)框架,首次让形态迥异的机器人基于意图理解实现自适应模仿与协作。

论文地址: https://www.science.org/doi/10.1126/scirobotics.adv2250

PART 01

传统模仿学习的困境:只能“照葫芦画瓢”

模仿学习是机器人获取新技能的常用方法,但它的核心逻辑是:演示者怎么做,学习者就怎么做。这就要求两者在同一条件下建立精确的运动映射 , 无人机怎么飞,地面机器人就得怎么飞。

问题在于,轮式机器人飞不起来。双臂机器人的精细操作,单臂机器人也无法直接复制。当机器人团队的成员形态各异、能力参差时,传统模仿学习几乎无从下手。这种对形态和环境的高度依赖,成了模仿学习在异构机器人团队中泛化的最大障碍。

研究团队从认知科学中找到了突破口。发展心理学研究表明,人类在学习时,会优先复现演示者的推断目标,而非其精确动作。一个婴儿看到大人用手打开盒子,如果大人的手被占用,婴儿会用嘴去开 , 他学的是“打开盒子”这个意图,而不是“用手”。

这就是“理性模仿”。它让人能够跨越身体形态的差异,完成行为迁移。

IAIL框架 要解决的 核心问题由此诞生:能否让机器人也具备这种能力 , 也就是 不对齐运动,而对齐意图?

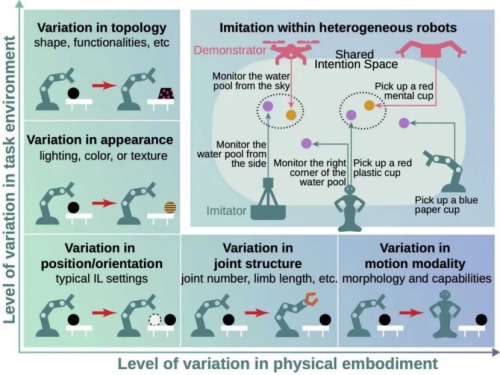

不同模仿学习场景的视觉示意图 。 传统模仿学习(左侧): 通常发生在物理形态或特定任务环境条件存在不同程度差异的两个机器人之间。跨体型模仿场景(右侧):形态迥异的异构机器人团队(例如无人机与无人船),也能通过自然语言注释所编码的高层意图在共享嵌入空间中建立语义对应关系,实现跨运动模态、跨工作空间的模仿与协作。

PART 02

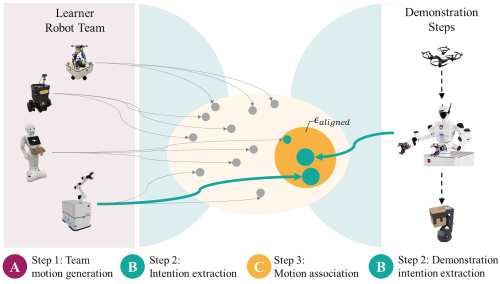

IAIL框架:三层结构,构建共享“意图空间”

IAIL框架采用“模块化生成 + 统一意图空间”的设计,由三个核心模块协作运行:

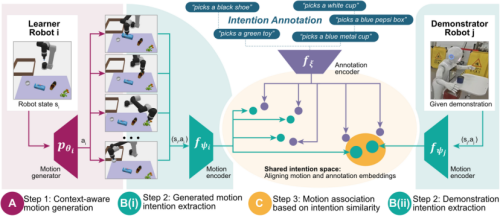

IAIL 框架在 智能体对智能体(Agent-to-Agent)场景下 的概述

第一层:生成自己的技能库

每个机器人都有一个独立的运动生成器,能根据当前状态生成一批安全、可执行的动作序列。各机器人的生成模型完全独立训练,无需跨机器人共享数据,部署门槛低。

第二层:把动作翻译成意图

系统为每个机器人训练一个运动编码器,同时训练一个所有机器人共享的标注编码器。语言标注(如“监控M1区域”“捡起黄色胶带”)作为语义监督信号,让具有相同意图的动作 , 无论来自何种形态的机器人 , 都能 在嵌入空间中彼此靠近。

第三层:用意图找匹配

当演示者做出动作时,系统将其转换为意图空间中的一个点,然后在学习者的“技能库”中寻找距离最近的点。最近的那个,就是要执行的动作。如果距离过远,说明学习者不具备执行该意图的能力,机器人会主动待机,而非冒险操作。这个设计的关键在于:机器人学的是“想做什么”,而不是“怎么做的”。

PART 03

真机实验:七类机器人,30个场景 , 成功率92%

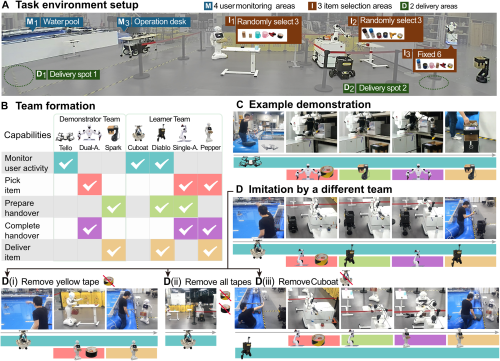

研究团队搭建了一个涵盖七类异构机器人的真实实验平台。他们将这些机器人分为两组:演示组由Tello无人机、双臂机械手和Spark差速轮机器人组成;学习组则包括Cuboat无人船、Diablo轮足机器人、Pepper人形机器人和一台单臂机械手。

任务设定为三阶段协作 。 监控用户活动(四个位置M1-M4)、拾取物品(三个区域I1-I3)、将物品送达指定地点(两个目的地D1/D2)。演示团队先完成一套五步演示,学习团队则需要复现最终结果 , 将正确的物品送到指定地点 。 但用户位置、物品类型和送货目的地并未明确告知 , 学习者必须通过观察演示,自己推断这些信息。

实验结果 显示,在30个多步协作场景中,有6个因机器人能力或物品缺失无法完成。剩余24个可行场景里,学习团队成功完成了22个,任务成功率92%。若将“是否做出最佳适应决策”作为评判标准(包括在无可行方案时选择待机),系统在全部30个场景中的准确率也达到了88%。

真实世界的实验装置和在各种条件下获得的模拟结果

PART 04

意图空间的两个关键性质

为了进一步评估IAIL学习到的共享意图空间的内部结构和鲁棒性 , 研究团队对256维潜在意图空间进行了分析,发现两个关键性质:

语义分离性:不同任务类型(监控、抓取、交付等)的嵌入之间全局类间余弦距离高达0.997±0.003,近乎正交。这意味着意图空间对不同任务有清晰的区分能力。

跨形态对齐性:执行同一任务的不同机器人,其嵌入质心之间的平均余弦距离低至0.030–0.031。无论是无人机、无人船还是地面机器人,执行“监控M1区域”时,它们在意图空间中的表征几乎重合 , 意图具备形态不变性。

这种结构让IAIL能够在不依赖形态对应关系的前提下,实现异构机器人之间的行为关联。

机器人团队之间的动作关联过程

PART 05

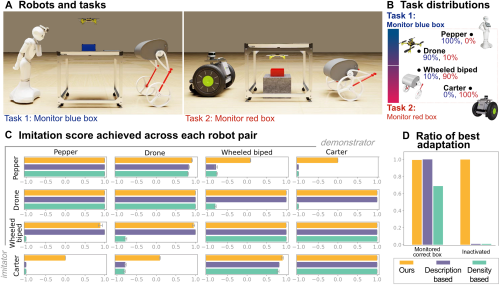

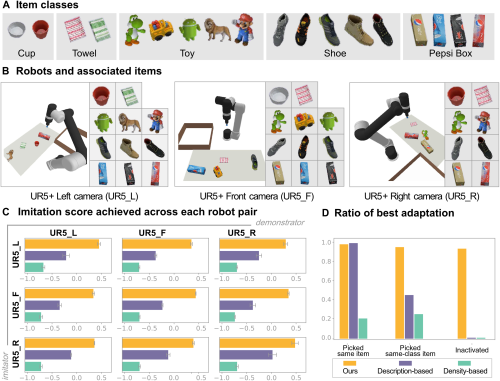

模拟验证:IAIL优于两类主流基线方法

为排除现实干扰、检验方法本质差异,研究团队在仿真环境中进行两项补充实验,与两类主流基线方法对比:

基于密度的映射:通过对齐动作分布建立对应关系

基于描述的翻译:将动作转为语言描述再解码

监控任务中,四台机器人(Pepper、Drone、Carter、Wheeled Biped)需要监控桌面蓝色盒子或桌下红色盒子。

由于构造限制,Pepper只能监控蓝色,Carter只能监控红色;Drone和Wheeled Biped虽两者皆可,但分别有90%的偏好倾向。结果显示 。 基于密度的方法对动作分布差异极为敏感,当演示者与学习者偏好不同时性能骤降;基于描述的方法虽对分布变化不敏感,但无法判断学习者是否具备执行能力(如让Carter模仿Drone的空中监控)。

拣选任务中,三台UR5机械臂运动学结构相同,但相机视角和可接触物品集各不相同,需从18件物品中拣选演示者指定的目标。结果显示 : 基于密度的方法在所有组合中得分最低,无法建立跨视角对应;基于描述的方法在演示物品可用时表现良好,但面对同类替代品时性能显著下降。两种方法均无法处理“演示动作无法执行”的情况。IAIL在所有组合中均取得最高分。

此外,两类基线方法均无法检测学习机器人何时无法完成任务。例如Pepper-Carter组合中,基于描述的方法平均得分为-1,意味着持续执行错误动作。这些结果表明,IAIL框架能够在不依赖形态对应关系的前提下,让异构机器人基于意图理解完成协作任务,学的是“想做什么”,而不是“谁在做”。

PART 06

与大语言模型的无缝集成

IAIL框架还有一个重要特性:它与大语言模型(LLMs)天然兼容。由于标注编码器与运动编码器经过联合训练,语言指令可以被直接映射到意图空间,实现从“示教轨迹”到“语言指令”的模态切换。这意味着,当采集人类示教轨迹不可行时,大语言模型可以自动生成指令作为替代示教。

研究团队展示了与ChatGPT-4.0的集成:大语言模型作为高层规划器生成任务指令,IAIL则负责在意图空间中找到与指令语义最匹配的可执行动作。IAIL框架的价值在于,它不追求训练一个适用于所有机器人的通用策略,而是为每个机器人保留独立的运动模型以尊重其物理约束,同时通过共享意图空间实现跨形态的行为关联。

这种设计降低了系统部署门槛,也为异构多机器人系统的协作提供了新思路。从更广的视角看,这项工作为通用人工智能的发展提供了一个可行路径 , 意图对齐的共享嵌入空间,可以作为跨形态的“元协议”,在保全个体功能特异性的同时,实现异构智能体之间的高阶语义对齐。