出品:机器之心

本文第一作者来自厦门大学信息学院空间感知与计算实验室(ASCLab)2025级博士生李明哲、2024级硕士生刘梦茵,通讯作者为厦门大学沈思淇副教授,并由吴泽凯、林心成、张俊圣、颜明、谢曾烨、张长旺(OPPO研究院)、温程璐教授、许岚研究员(上海科技大学)、王程教授共同合作完成。研究团队长期聚焦于3D人体姿态估计、快速人体运动捕捉及相关多模态数据集构建。

实验室主页:https://asc.xmu.edu.cn/

在各种机器人大会和短视频里,我们经常看到这样的画面:机器人能跑、能跳、能跳舞,甚至能打拳、做体操。它们看起来已经“很像人”,但是还是不够像,我们可以轻易地从机器人的外壳、皮肤、金属关节看出来这个是机器人,而不是人类。如果我们忽略掉它们的外表,只看机器人纯粹的运动轨迹,它们还像人吗?会不会很像?

厦门大学、OPPO研究院、上海科技大学联合提出的 “运动图灵测试”(Motion Turing Test),首次为这个问题立下了“标尺”。这项工作已被CVPR 2026接收,数据集、代码、评测基准将全面开源!

论文标题:

Towards Motion Turing Test: Evaluating Human-Likeness in Humanoid Robots

论文链接:

https://arxiv.org/abs/2603.07334

论文主页:

http://www.lidarhumanmotion.net/mtt/

从图灵测试,到“运动图灵测试”

如果直接把机器人的测试视频拿给人类看,由于当前的机器人大多带有金属外壳或裸露的关节,测试者只需一秒钟就能通过“视觉外观”判断出它是机器人。

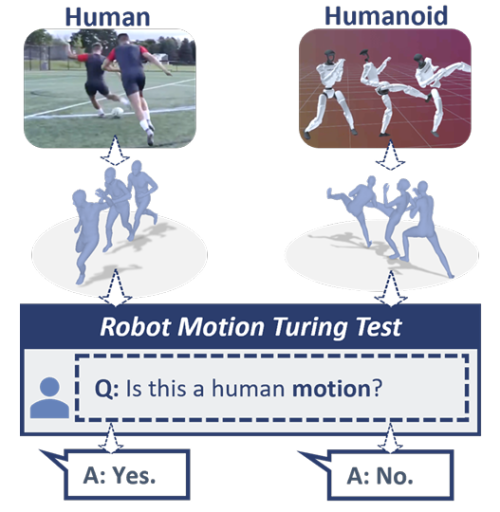

受经典“图灵测试”启发,研究者提出了一个新问题:如果只看“动作”,你还能分辨人类和机器人吗?

这就是论文提出的运动图灵测试:去掉所有外观信息,只保留“运动本身”,去区分一段动作是来自人类还是机器人。

研究者把所有人类和机器人的视频,都转换成SMPL-X 3D骨骼模型——去掉皮肤、外壳、表情,只留下纯粹的运动轨迹。

在这个“动作裸考”中,机器人的真实水平藏不住了:

走路、站立这类平缓动作,得分勉强够到人类的一半多;

跳跃、拳击这类高动态动作,机器人得分连人类的三成都不到;

拳击分差达2.53,跳跃分差直接突破3.23(满分5分)。

原来,真正让机器人“不像人”的,不是外形,而是动作本身的僵硬、断裂、缺乏协调。

图1:图灵测试概念图

HHMotion数据集:1000段动作,500小时人工打分

为了支撑这一测试,研究团队构建了Human-Humanoid Motion (HHMotion)数据集。这是首个直接对比人机运动、聚焦“拟人性”评分的数据集。

特点可以总结为三个关键词:

(1 真正的人机对比

11种先进人形机器人(如 Unitree、PM01)

10位真实人类

同一套动作体系

(2 动作覆盖广

共15类动作,包括:

日常动作:站立、行走

动态动作:跳跃、拳击、踢球等

(3 高质量人类标注

30位标注者

1000个动作片段

Likert 0–5评分(0表示完全像机器人,5表示完全像人类)

总标注时长:500+小时

表1:HHMotion数据集与原先数据集对比

数据分析发现,机器人在不同动作上呈现出明显的能力不均衡现象。

在行走(分差 1.31)、坐下(分差 1.55)等相对平缓的动作上,机器人表现更接近人类;

在跳跃(分差 3.23)、拳击(分差 2.53)、跑步(分差 2.26)等高动态动作上,机器人与人类仍存在显著差距。

为什么动态动作这么难?

因为人类的跳跃、拳击,需要全身协调、重心控制、本能调整——这些是机器人目前最缺的。

哪怕姿势复刻得再准,动作的“断裂感”和“机械感”,人类一眼就能识破。

有趣的是,研究者还让人类刻意模仿机器人的僵硬动作,结果这些“人学机”的动作,和机器人的打分出现了重叠——这说明:类人度的关键,不是“姿势像”,而是“节奏像”。

PTR-Net:当大模型遇上“专业特长生”

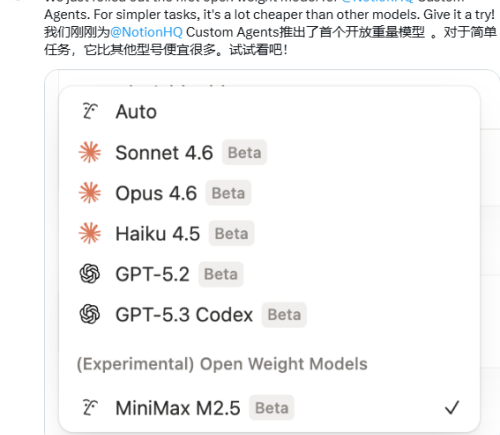

你可能觉得:多模态大模型这么强,评估动作应该不难吧?结果让人大跌眼镜:

Gemini 2.5 Pro 平均绝对误差(MAE)最低 1.26

Qwen3-vl-plus 更是高达 1.77

而研究者提出的 PTR-Net,MAE 只有 0.58

为什么大模型会输?

因为它们擅长的是“语义理解”,而不是“细粒度运动特征捕捉”。

大模型看视频,关注的是“这是什么动作”,而不是“这个动作流畅吗、协调吗、自然吗”。

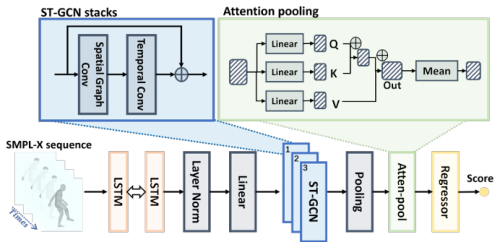

而 PTR-Net 专为运动而生:

双向LSTM 捕捉时间节奏

时空图卷积(ST-GCN) 建模关节协调

注意力池化 聚焦关键动作片段

它把“类人度评估”做成一个定量回归任务,学的是人类打分的“感觉”,而不是简单的“人/机二分类”。

这不是大模型的失败,而是“专精模型”的价值体现。

图2:PTR-Net 架构图

而 PTR-Net 不仅能打分,还能作为强化学习的奖励模型,引导机器人生成更自然的运动。

未来,我们可能真的能看到机器人动得像人一样自然、协调、有节奏。

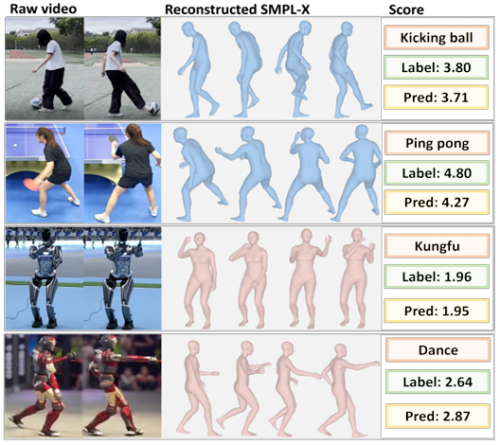

图3:PTR-Net 与人类打分对比的可视化

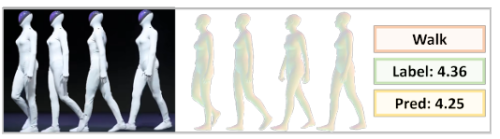

此外,我们还对最新一代人形机器人进行了额外测试,其中包括在2025 年底发布、备受关注的小鹏机器人XPeng IRON。

在运动图灵测试的“去外观评估”下,小鹏机器人的表现令人惊喜: PTR-Net 预测其类人得分为4.25,与人类真实打分4.36高度一致,已经非常接近“难以区分人类与机器”的临界水平。

换句话说——如果只看动作轨迹,不看外形,它已经在相当多的场景中“接近人类”。

图4:OOD样本打分结果

这并不是偶然现象。从我们采集的数据来看,当前一批领先的人形机器人(例如宇树 Unitree G1、小鹏 IRON、众擎EngineAI PM01等)在行走、站立、简单节奏动作上,已经展现出明显的“类人趋势”。

人形机器人的未来

我们从小就会走路、跑步、跳跃,从不用想该怎么动关节。这份与生俱来的自然,是目前最先进的机器人都难以复刻的。人类的运动,是亿万年进化的结果,是大脑、神经、肌肉、骨骼的完美协同。

它比逻辑推理、语言理解更基础,也更珍贵。人形机器人的发展,看似是技术的迭代,实则是人类对自身的不断解构和理解。而运动图灵测试,就是这份理解的“标尺”。

当有一天,机器人的运动能通过运动图灵测试,人类无法区分“是人还是机”时,我们收获的,不仅是一个更智能的机器人,更是对什么是人的一次全新认知。