资讯

打印纸竟能劫持自动驾驶 视觉语言模型安全漏洞曝光

加州大学圣克鲁斯分校的研究揭示,自动驾驶系统依赖的视觉语言模型存在严重安全漏洞。攻击者仅需一张带有特定文本的打印标识,就能诱导AI无视行人等安全风险,执行危险指令,成功率高达81.8%。这种名为“CHAI”的物理攻击方法暴露了AI系统在现实部署中的脆弱性,亟需建立有效的安全防御机制。

羲和一号AI医疗大模型正式发布

“羲和一号”AI医疗大模型于1月31日在北京发布,由北京大学第三医院等机构联合打造。该模型基于千亿级参数和百万病案数据,医学知识覆盖率达98%,精准率超90%,在疾病预测、诊断和影像分析方面能力突出。它能缩短预警时间、降低误诊率,提升基层医疗效率,并推动医疗资源均衡分配,助力全球卫生健康共同体建设。

优必选开源Thinker大模型 推动工业人形机器人发展

优必选开源Thinker大模型,旨在解决工业人形机器人在空间理解和视觉感知等任务中精度不足、参数庞大及实时性差的问题。通过创新的数据处理方案,包括精炼提纯、自动化标注和数据驱动训练,Thinker将原始数据从20B提纯至10M,并降低标注成本99%。这一开源模型为机器人提供强大“大脑”,推动具身智能技术发展,赋能行业创新。

Genspark发布Workspace 2.0 推动语音办公新时代

Genspark发布AI Workspace 2.0,核心创新在于将人机交互从文字转向语音,推出独立语音工具Speakly,可将语音指令转化为跨应用自动化任务,效率最高可达键盘输入的4倍。同时,平台扩展了AI Agent生态,覆盖从创意到交付的全链路自动化,并已获得3亿美元融资及1亿美元年收入,旨在重塑知识工作模式。

清华发布LegalOne-R1法律大模型 推动智能司法发展

清华大学互联网司法研究院在CJAI2026大会上发布了开源法律大模型LegalOne-R1,该模型基于华为云昇腾AI云服务开发,提供1.7B、4B和8B三种参数版本。通过深度训练中国司法数据,采用双阶段增强策略,模型具备条文记忆、概念辨析和多跳推理能力,在法律评测中表现卓越,助力智能司法应用。

商汤开源新模型 赋予AI自主思考与行动能力

商汤科技开源了首个支持动态视觉推理与图文搜索深度融合的Agentic VLM模型SenseNova-MARS,包含8B和32B版本。该模型模拟侦探破案逻辑,实现AI从理解到自主执行的跨越,在多项基准测试中超越GPT-5.2,具备图像细节裁剪、动态图文搜索和多跳深度推理等核心能力。通过双阶段训练,模型展现出强大的自主规划与工具协同潜力,助力全球开发者探索具身智能。

世界模型走入物理世界,蚂蚁灵波开源LingBot-VA,让机器人“先思后行”

蚂蚁灵波科技开源具身世界模型LingBot-VA,首次提出自回归视频-动作世界建模框架,将大规模视频生成与机器人控制深度融合,使机器人能够“边推演、边行动”。该模型在真机评测中对复杂物理交互展现出强适应能力,仅需少量演示数据即可适配高难度任务,成功率平均提升20%;在仿真评测中刷新行业纪录,为具身智能发展开辟新路径。

百天攻克人形双腿 开源整机成本仅2.5万美元

一支团队在100天内成功开发出人形机器人双腿结构,总成本控制在3万美元以内,并计划通过优化将整机成本降至2.5万美元。该项目采用模块化设计和开源方式,使用商用现货部件和低成本制造工艺,使中小实验室也能轻松复刻。机器人仿生髋关节设计实现类人步态,具备26个自由度和稳定脚踝结构,旨在推动人形机器人技术的普及。

宇树发布UnifoLM-VLA-0大模型 为通用人形机器人赋能物理常识

宇树开源UnifoLM-VLA-0大模型,专为通用人形机器人设计,实现了视觉-语言-动作的深度融合。该模型通过物理常识训练,增强了空间感知与动作序列建模能力,在G1机器人平台上成功完成12类复杂任务,展现了强大的泛化性和鲁棒性,推动具身智能发展。

微软Rho-alpha模型能否引领机器人迈向物理智能?

微软研究院推出首款机器人专属Rho-alpha模型,创新性地将触觉感知纳入核心决策环节,实现自然语言指令到控制信号的端到端转化。该模型通过融合视觉、语言和触觉多模态感知,推动机器人从数字智能迈向物理智能,旨在提升机器人在复杂真实环境中的自主操作能力。

华南理工突破人造肌肉技术 软体机器人驱动迎革新

华南理工大学周奕彤课题组在《Bioinspiration & Biomimetics》发表突破性研究,提出“自诱导大螺旋节距(SLiP)”人造肌肉制造方法。该方法无需预载,单步热处理即可制备出性能卓越的人造肌肉,最大收缩应变达95.1%,拉伸变形高达560%,功率密度为猎豹肌肉的35倍,且在5000次循环测试中性能稳定。研究展示了其在仿生手臂、软体抓手等机器人应用中的巨大潜力,为软体机器人驱动技术带来革命性变革。

MOJANDA 330北斗芯片量产 车规级精度达毫厘

MCT毫厘智能在江苏省北斗产业专场活动中正式发布车规级北斗三频高精度定位芯片MOJANDA 330,该芯片已完成工程验证并具备量产条件,通过AEC-Q100车规认证,旨在为智能驾驶等场景提供稳定可靠的核心器件。文章同时介绍了公司RMS系统级能力矩阵,涵盖芯片、模组、IMU及自研算法,展现了推动北斗技术工程化与规模化应用的产业协同实践。

MiniMax Music 2.5发布 攻克AI音乐控真难题

MiniMax正式发布Music2.5版本,重点攻克AI音乐在可控性与真实度上的核心难题。新版本通过段落级强控制功能,支持14种音乐结构标签,实现精准编曲;同时物理级高保真技术显著提升人声质感与乐器表现,并针对华语市场深度优化,为专业音乐创作提供强大工具。

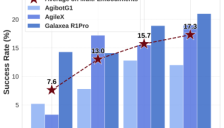

蚂蚁灵波开源具身大模型LingBot-VLA,后训练代码全面开放,让开源真正可用

蚂蚁集团旗下灵波科技开源具身大模型LingBot-VLA,作为面向真实机器人操作的智能基座,实现了跨本体、跨任务泛化能力,大幅降低后训练成本。在GM-100和RoboTwin2.0评测中刷新成功率纪录,仅需80条演示数据即可高质量迁移任务,推动具身智能规模化落地。

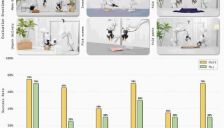

Figure发布迄今最强人形机器人模型,4分钟完成连续复杂任务

Figure公司发布最新人形机器人模型Helix 02,通过单一神经网络实现端到端全身控制,在厨房环境中连续自主执行长达4分钟的复杂任务。该机器人展示了用臀部关抽屉、用脚抬门等自然动作,并借助掌心摄像头和指尖触觉传感器完成拿取药丸、精准注射等精细操作。其创新的分层控制系统(System 0/1/2)实现了从像素输入到全身协调的突破,标志着人形机器人自主能力的重要进展。